SHOWROOMは、2月22日、『SHOWROOM』で悪質コメントを検知し、投稿される前にブロックするコンテンツモデレーションAI機能を自社開発し、搭載したことを明らかにした。

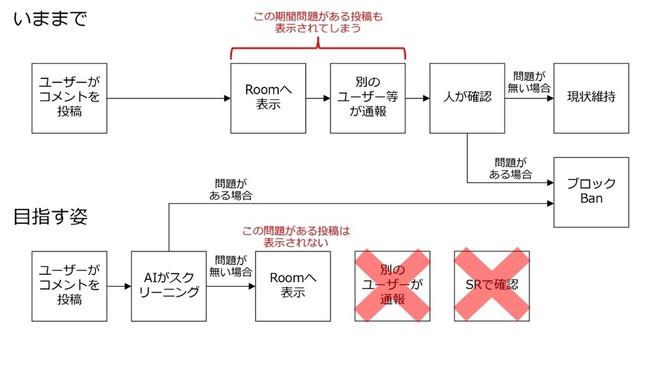

■コンテンツモデレーションAI機能スキーム図

これまでは視聴者から悪質なコメントが投稿されると、別の視聴者やライバー自身が通報し、SHOWROOM 監視チームがコメント確認後にブロック作業を行っていた。そのため、コメントに問題があった場合も監視チームの確認が完了するまでの間は表示された状態だった。

しかし、コンテンツモデレーションAI機能を導入することで、誹謗中傷を中心とする悪質なコメントが視聴者によって書き込まれた際、AIがスクリーニングを行う。問題がある場合には、投稿される前に自動でブロックできる。そのため、不快なコメントを、ライバーはもちろん、別の視聴者が目にする機会を大幅に軽減することが可能になったという。

今回のタイミングでは、その前段階として、AIがユーザーの変わりに通報を行う機能を実装。悪質なコメントをこれまで以上に早く確認し、投稿削除するまでのスピードを一層あげることが可能となる。今後は、精度を上げながら、自動的にユーザーの悪質投稿を表示させない機能をリリースしていく。なお、本機能については、特許を出願中とのこと。

■日本初のAIスクリーニング機能誕生の背景

匿名での投稿をメインとするSNSで見受けられる誹謗中傷。社会問題になると共に、これをもとにした犯罪が近年急増している。SHOWROOMとしても、悪意のあるコメントにこれまで確固たる対応をとってまいりました。しかしながら、監視チームの24時間体制のパトロール、ならびに視聴者の皆さんから寄せられる通報をもってしても、悪意のあるコメントの投稿を事前に防ぐことは難しく、一時的にライバーや視聴者の目に触れてしまっていた。

互いの交流を楽しみにしているライバーと視聴者の時間を無駄にしたくない、楽しい体験の最中に不快な感情を与えたくない、そんな想いから誕生したのが本サービスとなる。AIスクリーニングを駆使することにより、ライバーや視聴者の目に触れる前に投稿を削除。誹謗中傷によるダメージを限りなくゼロに近づけていく予定。なお、悪質コメントを事前に察知し、投稿前に削除するAIスクリーニング本機能は、日本初(※)と説明している。

(※)日本初は同社調べ

コンテンツモデレーションAIのテクノロジー

ディープラーニングをコンテンツモデレーション機能に応用。従来のキーワード等の検出ではなく、文脈を含めてコメントをニューラルネットワーク上で抽象化し、即時にそのコメントの悪質性を判断。投稿前に自動削除することを可能とした。ライブ配信プラットフォームのパイオニアでもあるSHOWROOMの、膨大なコメントのデータを活用することで、高い確率で悪質コメントを検知することに成功した。

会社情報

- 会社名

- SHOWROOM